Augmnentation des attaques et menaces deepfakes 2025 selon les experts en biométrie et cybersécurité

En ce début d’année 2025, des entreprises spécialisées dans la cybersécurité et la lutte contre la fraude, telles que iProov, Pindrop, Reality Defender, Tools For Humanity et Palo Alto Networks, partagent leurs prédictions sur l’avenir des deepfakes, de la biométrie, des violations de données et des réglementations sur l’IA.

Table de Contenu

Une augmentation alarmante des deepfakes

Selon Pindrop Security, connue pour avoir identifié en 2024 de faux appels robotiques attribués à Joe Biden grâce à son moteur biométrique vocal, les attaques par deepfake devraient continuer à croître à un rythme inquiétant. En effet, la société basée aux États-Unis a enregistré une augmentation de 1 400 % des attaques deepfake au cours du premier semestre 2024. Cette tendance devrait se poursuivre en 2025, avec des attaques de plus en plus médiatisées.

L’année pourrait également être marquée par la première violation à grande échelle d’archives audio et vidéo confidentielles, lesquelles pourraient être utilisées pour entraîner des IA à des fins malveillantes, avertit Vijay Balasubramaniyan, PDG et cofondateur de Pindrop.

Une menace pour l’intégrité des médias

La prolifération des deepfakes constitue une menace majeure pour l’intégrité des médias et des informations. iProov, une société britannique spécialisée dans la vérification faciale biométrique, souligne l’importance d’introduire des technologies d’attribution de contenu pour contrer ces risques.

Pour les entreprises, les dangers ne se limitent pas aux fausses informations. Les deepfakes pourraient être utilisés pour des fraudes liées au recrutement, comme l’incident signalé par KnowBe4 en 2024. L’entreprise de cybersécurité a découvert qu’un ingénieur logiciel recruté à distance était en réalité un acteur nord-coréen utilisant une identité américaine volée et une photo modifiée par IA.

2025 : l’année des réglementations anti-deepfake

Pour Steven Smith, responsable des protocoles chez Tools For Humanity, développeur principal de la plateforme World(anciennement Worldcoin), si 2024 a été l’année des deepfakes, 2025 doit être celle de la réglementation anti-deepfake .

Il souligne dans une tribune pour Forbes que les lois encadrant les deepfakes restent fragmentées aux États-Unis. Certains États, comme la Floride, le Texas et Washington, ont commencé à légiférer, mais ces efforts en sont encore à leurs débuts. En attendant, des outils technologiques seront nécessaires pour prouver l’authenticité des individus en ligne. En octobre dernier, World a ajouté une fonctionnalité de détection de deepfake à son système d’identité numérique World ID.

Menaces Deepfakes : une révolution dans l’industrie financière

Les deepfakes transforment également le secteur financier, selon le fabricant de technologies de détection Reality Defender. Ces technologies sont de plus en plus utilisées pour contourner les mesures de sécurité traditionnelles. Les entreprises se tournent donc vers des solutions comme l’authentification multifactorielle (MFA) pour prévenir les accès non autorisés.

Parmi les mesures adoptées figurent :

– La détection de « liveness », qui analyse audio, vidéo et images pour repérer les manipulations IA ;

– La formation des employés à reconnaître les deepfakes ;

– Des processus de vérification, comme les protocoles de rappel.

Selon Reality Defender, qui a récemment levé 33 millions de dollars lors d’une extension de sa série A, les outils de détection multimodale sont essentiels pour les organisations financières.

Menaces Deepfakes: vers des défenses quantiques

En 2025, les entreprises chercheront également à réduire le nombre d’outils de cybersécurité utilisés en adoptant des plateformes unifiées, prédit Palo Alto Networks. Ce changement sera motivé par la nécessité de réduire la complexité, d’augmenter l’efficacité et de pallier la pénurie de compétences en cybersécurité.

Simon Green, président de Palo Alto Networks pour l’Asie-Pacifique et le Japon, insiste sur l’importance d’adopter des **défenses résistantes aux technologies quantiques** face à l’évolution rapide des menaces. Ces solutions incluent des tunnels sécurisés, des bibliothèques de données cryptographiques et d’autres technologies avancées.

> « Alors que l’informatique quantique devient de plus en plus une réalité, il sera essentiel de mettre en place ces mesures pour prévenir le vol de données et garantir l’intégrité des systèmes critiques », conclut Green.

Analyse des tendances Menaces Deepfakes :

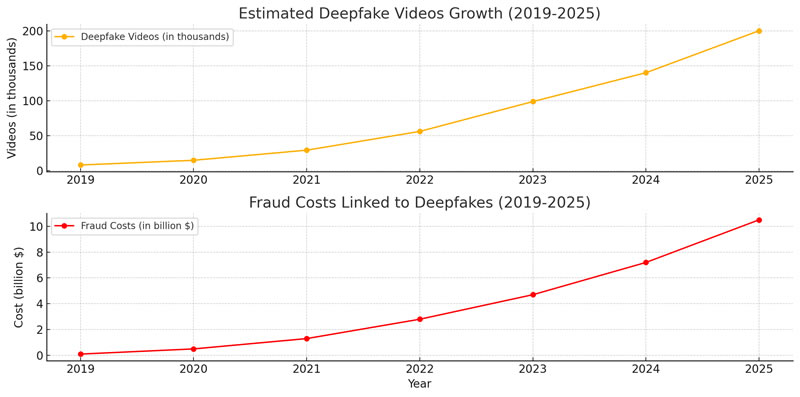

- Augmentation rapide des vidéos deepfake : La disponibilité d’outils IA open-source et de contenus libres de droits a facilité la création de deepfakes, avec une forte hausse entre 2019 et 2022.

- Diversification des usages malveillants : Alors que les premières utilisations ciblaient principalement la désinformation et la pornographie non consentie, les applications se sont étendues à des domaines comme la fraude financière et le recrutement.

- Coût croissant pour les organisations : Les pertes liées aux deepfakes augmentent à mesure que les attaques deviennent plus sophistiquées.

Tendances des deepfakes dans le monde entre 2019 et 2025 :

- Croissance des vidéos deepfake estimées : Le nombre de vidéos deepfake montre une augmentation exponentielle, passant de moins de 8 000 en 2019 à une prévision de 200 000 en 2025.

- Coût global des fraudes liées aux deepfakes : Les pertes financières augmentent rapidement, atteignant potentiellement 10,5 milliards de dollars en 2025.

Tableau Tendances des Menaces Deepfakes dans le monde

Ces données reflètent les principales applications et les menaces deepfakes dans différents secteurs, basées sur des rapports et des prévisions en cybersécurité.

| Année | Nombre estimé de vidéos Deepfake | Croissance annuelle (%) | Principaux usages malveillants | Coût global des fraudes liées aux deepfakes (milliards $) |

|---|---|---|---|---|

| 2019 | 7 964 | – | Propagation de fausses informations, pornographie non consentie | 0.1 |

| 2020 | 14 698 | 84% | Désinformation politique, chantage, usurpation d’identité | 0.5 |

| 2021 | 29 155 | 98% | Fraudes financières, manipulation médiatique | 1.3 |

| 2022 | 56 000 | 92% | Escroqueries à l’embauche, falsification de preuves juridiques | 2.8 |

| 2023 | 98 700 | 76% | Piratage vocal, intrusion aux systèmes de sécurité | 4.7 |

| 2024 | 140 000 | 42% | Fraudes bancaires, recrutement de menace | 7.2 |

| 2025 (prévision) | 200 000 | 43% | Usurpation biométrique, vol d’identités massives | 10.5 |

FAQ sur les Menaces des Deepfakes

Qu’est-ce qu’un deepfake ?

Un deepfake est une technologie qui utilise l’intelligence artificielle (IA) pour manipuler des contenus multimédias (vidéos, audios ou images) en remplaçant ou en modifiant des visages, des voix ou d’autres éléments pour créer une illusion réaliste. Le terme « deepfake » provient de l’association des mots « deep learning » (apprentissage profond) et « fake » (faux).

Quels sont les dangers associés les menaces deepfakes ?

Les deepfakes présentent plusieurs risques, notamment :

Désinformation : Ils peuvent être utilisés pour créer de fausses informations ou manipuler l’opinion publique .

Cyberharcèlement : Les deepfakes peuvent être employés pour produire des contenus compromettants ou humiliants.

Fraude : Utilisation dans des arnaques, comme l’usurpation d’identité ou l’escroquerie (par exemple, imitation de la voix pour soutirer des fonds).

Atteinte à la vie privée : Création de contenus explicites ou compromettants à partir d’images volées.

Impact sur la confiance : Perturbation de la confiance dans les médias, les institutions et les interactions sociales.

Comment reconnaître un deepfake ?

Bien que les deepfakes soient de plus en plus sophistiqués, certains signes peuvent les trahir :

Des mouvements de lèvres qui ne correspondent pas à l’audio.

Une qualité d’image inégale, surtout autour du visage.

Des clignements des yeux ou expressions faciales anormales.

Des détails incohérents (ombres, réflexions, etc.).

Une voix qui semble artificielle ou robotique.

Quels outils permettent de détecter les deepfakes ?

Plusieurs outils et plateformes ont été développés pour détecter les deepfakes, notamment :

Deepware Scanner : Une application pour identifier les deepfakes.

Microsoft Video Authenticator : Analyse des vidéos pour repérer des anomalies.

Reality Defender : Extension de navigateur pour détecter les contenus suspects.

Que faire si vous êtes victime d’un deepfake ?

Signalez le contenu : Sur les réseaux sociaux ou aux autorités concernées.

Contactez un avocat : Pour explorer vos recours légaux, notamment en matière de diffamation ou d’atteinte à la vie privée.

Sensibilisez votre entourage : Informez vos proches pour éviter la propagation.

Conservez les preuves : Capturez et sauvegardez le contenu incriminé.

Comment se protéger contre les deepfakes ?

Renforcez vos paramètres de confidentialité sur les réseaux sociaux.

Évitez de partager des informations personnelles ou sensibles en ligne.

Utilisez des outils de protection : Certaines applications permettent de marquer vos contenus (ex. : tatouage numérique).

Restez vigilant face aux contenus viraux : Vérifiez la source avant de croire ou de partager.

Les deepfakes ont-ils des applications positives ?

Oui, les deepfakes ne sont pas uniquement négatifs. Ils peuvent être utilisés dans :

L’industrie du divertissement : Création d’effets spéciaux ou reconstitution d’acteurs décédés.

L’éducation : Simulations et reconstitutions historiques.

La santé : Aide à la communication pour les personnes ayant des troubles vocaux.

Quelles réglementations existent contre les deepfakes ?

Certaines juridictions ont adopté des lois pour lutter contre les abus liés aux deepfakes. Par exemple :

Union européenne : Le Règlement général sur la protection des données (RGPD) protège contre l’utilisation abusive des données personnelles.

États-Unis : Certaines états comme la Californie et le Texas ont des lois spécifiques pour interdire les deepfakes en période électorale ou à des fins de harcèlement.

Comment l’avenir des deepfakes est-il perçu ?

L’évolution rapide de cette technologie pose des défis majeurs, mais elle encourage également le développement d’outils de détection et de réglementations pour prévenir les abus. La vigilance et la sensibilisation restent essentielles pour limiter leurs impacts négatifs.