Arnaque IA Deepfake : une entreprise de Hong Kong perd 26 millions de dollars en 2024

Une multinationale basée à Hong Kong a été victime d’une fraude d’envergure, orchestrée à l’aide de deepfakes et d’intelligence artificielle. Les escrocs ont dérobé 26 millions de dollars en se faisant passer pour des cadres supérieurs de l’entreprise lors d’une visioconférence truquée, selon la police hongkongaise.

Un scénario sophistiqué et réaliste

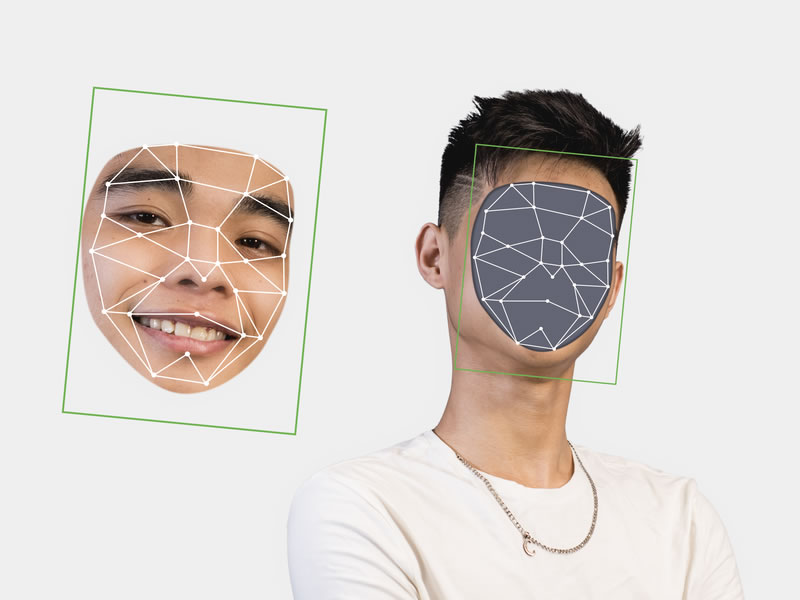

Le stratagème débute par un mail, prétendument envoyé par le directeur financier basé à Londres, demandant au salarié de traiter une transaction secrète. Méfiant au départ, ce dernier est rassuré après une visioconférence où il reconnaît ce qu’il croit être ses collègues, leur voix et leurs visages. Mais ces « collègues » n’étaient que des deepfakes créés à partir de vidéos publiques disponibles sur internet, trafiquées pour imiter leurs apparences et voix.

Les fraudeurs ont utilisé des images et audios trouvés sur YouTube et d’autres sources publiques, modifiant les mouvements des lèvres et les dialogues pour rendre les vidéos crédibles. Grâce à ces montages réalistes, ils ont convaincu le salarié d’effectuer plusieurs virements totalisant 26 millions de dollars. Ce n’est qu’une semaine plus tard que la supercherie a été découverte, lorsque le salarié a contacté ses vrais collègues.

Une fraude facilitée par l’IA

La police hongkongaise a confirmé que tout était préenregistré, sans véritable interaction en direct. Les progrès rapides de l’intelligence artificielle permettent désormais de produire des deepfakes d’une qualité impressionnante, même pour des visioconférences où l’image est souvent de faible résolution.

Ce type d’escroquerie s’inscrit dans la lignée de l’arnaque au président, où l’identité d’un dirigeant est usurpée pour obtenir des virements bancaires d’un employé. En 2024, l’utilisation des deepfakes amplifie ces fraudes, rendant les supercheries plus crédibles et plus difficiles à détecter.

Arnaque IA Deepfake un phénomène en expansion

Les autorités hongkongaises observent une recrudescence des arnaques exploitant l’IA et les deepfakes. Ces techniques sophistiquées représentent une menace croissante pour les entreprises, particulièrement celles ayant une forte présence numérique. Dans ce cas, aucune arrestation n’a encore été réalisée, et les 26 millions de dollars restent introuvables.

Cette affaire souligne l’urgence pour les entreprises de renforcer leurs protocoles de sécurité et de sensibiliser leurs employés aux nouvelles formes de cybercriminalité facilitée par l’intelligence artificielle.

Foire aux questions « Arnaque IA Deepfake »

Qu’est-ce qu’un deepfake ?

Un deepfake est une vidéo, un audio ou une image généré(e) ou modifié(e) grâce à l’intelligence artificielle, dans le but d’imiter une personne réelle. Il peut recréer un visage, une voix ou des mouvements, souvent de manière très réaliste.

Comment fonctionne un deepfake ?

Le deepfake repose sur des algorithmes d’apprentissage automatique, en particulier les réseaux neuronaux. Ces modèles analysent des images ou des enregistrements existants pour apprendre les traits, expressions et voix d’une personne, puis les reproduisent ou les manipulent dans un nouveau contexte.

À quoi sert un deepfake ?

Le deepfake a des usages légitimes dans le divertissement (cinéma, doublage), l’éducation (reconstitutions historiques), ou encore la création artistique. Cependant, il est souvent détourné à des fins malveillantes, comme la diffusion de fausses informations, la fraude ou le harcèlement.

Quels sont les risques liés aux deepfakes ?

Escroqueries et fraudes financières : comme l’arnaque au président amplifiée par des visioconférences deepfake.

Diffusion de fausses informations : manipulation d’opinions publiques avec des vidéos truquées.

Atteinte à la vie privée : création de contenus non consensuels (ex. : deepfakes pornographiques).

Usurpation d’identité : utilisation pour compromettre la crédibilité ou les actions d’une personne.

Comment reconnaître un deepfake ?

Bien que les deepfakes soient de plus en plus réalistes, certains indices peuvent trahir leur nature :

Des mouvements des lèvres mal synchronisés avec le son.

Une qualité d’image fluctuante ou des artefacts visuels.

Des clignements d’yeux irréguliers ou absents.

Une voix qui semble robotisée ou qui manque d’intonation naturelle.

Peut-on se protéger contre les deepfakes ?

Vérifiez les sources : privilégiez des médias fiables.

Utilisez des outils de détection : certains logiciels peuvent identifier les deepfakes.

Sensibilisez vos équipes : formez vos employés à reconnaître les techniques de manipulation.

Sécurisez vos données : limitez la publication de contenus personnels qui pourraient être exploités.

Quels sont les outils pour détecter un deepfake ?

Des outils comme Deepware Scanner, Microsoft Video Authenticator, ou des solutions développées par des chercheurs en IA permettent de détecter les traces d’altération numérique.

Quelle est la législation autour des deepfakes ?

Les lois varient selon les pays. Certains, comme la Chine ou les États-Unis, ont commencé à encadrer les deepfakes, notamment lorsqu’ils sont utilisés pour du contenu pornographique non consensuel ou des manipulations électorales.

Que faire si je suis victime d’un deepfake ?

Signalez le contenu sur les plateformes où il est publié.

Contactez un avocat spécialisé en cybersécurité ou en droits numériques.

Prévenez les autorités compétentes pour signaler une usurpation ou une fraude.

Diffusez une clarification pour contrer les effets négatifs du deepfake.

Comment l’IA peut-elle aider à contrer les deepfakes ?

L’intelligence artificielle, en plus de créer des deepfakes, est également utilisée pour les détecter. Des algorithmes de détection analysent les anomalies dans les vidéos ou les sons pour repérer des contenus manipulés. Les entreprises technologiques travaillent activement à renforcer ces outils pour lutter contre les abus.